De las estadísticas básicas al análisis táctico avanzado: una breve historia

Durante gran parte del siglo XX, el análisis del fútbol se basaba en métricas simples y fácilmente comprensibles: goles marcados, partidos ganados o clasificación en la tabla. Estos datos ofrecían una visión general del rendimiento, pero dejaban fuera muchos matices del juego, como el posicionamiento, la toma de decisiones o el impacto colectivo de los jugadores.

Con la llegada de nuevas tecnologías a finales del siglo XX y principios del XXI, el panorama comenzó a cambiar. La digitalización de los partidos permitió recopilar información mucho más detallada, desde el número de pases completados hasta la distancia recorrida por cada jugador. Esto supuso el primer paso hacia un análisis más profundo, en el que no solo importaba el resultado, sino también cómo se había conseguido.

En la última década, el desarrollo del llamado análisis avanzado ha llevado esta evolución aún más lejos. Conceptos como los “goles esperados” (xG), los mapas de calor o los modelos predictivos han pasado a formar parte habitual del discurso futbolístico. Estos sistemas no solo describen lo que ocurre en el campo, sino que intentan interpretar patrones y anticipar comportamientos, ofreciendo una comprensión más compleja del juego.

Además, los clubes profesionales han integrado equipos especializados en análisis de datos dentro de sus estructuras. Estos analistas trabajan junto a entrenadores y cuerpos técnicos para evaluar rivales, optimizar estrategias y mejorar el rendimiento individual y colectivo. Así, el uso de datos ha dejado de ser un complemento para convertirse en una herramienta habitual en la toma de decisiones.

Esta evolución refleja un cambio más amplio en la forma de entender el fútbol: de una visión centrada únicamente en el resultado a otra que también valora los procesos y el contexto. Sin embargo, también ha abierto el debate sobre hasta qué punto los datos pueden capturar la esencia de un deporte tan dinámico e imprevisible.

Qué mide realmente el análisis de datos en el fútbol moderno

El análisis de datos en el fútbol moderno busca cuantificar lo que ocurre en el campo más allá del resultado final. No se limita a contar acciones, sino que intenta medir la calidad, el contexto y el impacto de cada jugada, tanto a nivel individual como colectivo.

Uno de los conceptos más conocidos es el de los goles esperados (xG), una métrica que estima la probabilidad de que una ocasión termine en gol en función de factores como la distancia al arco, el ángulo de disparo, el tipo de asistencia o la presión defensiva. De este modo, no solo se analiza cuántos goles se marcan, sino si un equipo genera oportunidades de alta o baja calidad.

Otra estadística relevante es el PPDA (pases permitidos por acción defensiva), que se utiliza para medir la intensidad de la presión de un equipo. Cuantos menos pases permite un conjunto antes de intentar recuperar el balón, mayor es su nivel de presión. Esta métrica ayuda a entender estilos de juego y comportamientos tácticos que no siempre son evidentes a simple vista.

El análisis moderno también incorpora métricas posicionales, que estudian cómo se distribuyen los jugadores en el campo y cómo interactúan entre sí. A través de mapas de calor, redes de pases o seguimiento de movimientos, se pueden identificar patrones como la ocupación de espacios, la compactación del equipo o la generación de líneas de pase. Estas herramientas permiten analizar no solo lo que hace un jugador con el balón, sino también su influencia sin él.

Para entender correctamente estas métricas avanzadas, primero es importante tener claros los fundamentos del fútbol y sus principios básicos, ya que el análisis de datos parte siempre de cómo se estructura el juego en su esencia.

Además, existen indicadores relacionados con el rendimiento físico, como la distancia recorrida, la velocidad máxima o el número de sprints, que aportan información sobre la exigencia del juego y la preparación de los futbolistas.

En conjunto, estas métricas ofrecen una visión más completa del partido, combinando datos técnicos, tácticos y físicos. El objetivo no es sustituir la observación tradicional, sino complementarla con información objetiva que ayude a interpretar mejor el desarrollo del juego. Fundamentos del fútbol: qué son, cuáles son y cómo se trabajan

Expected Goals (xG): la métrica que lo cambió todo

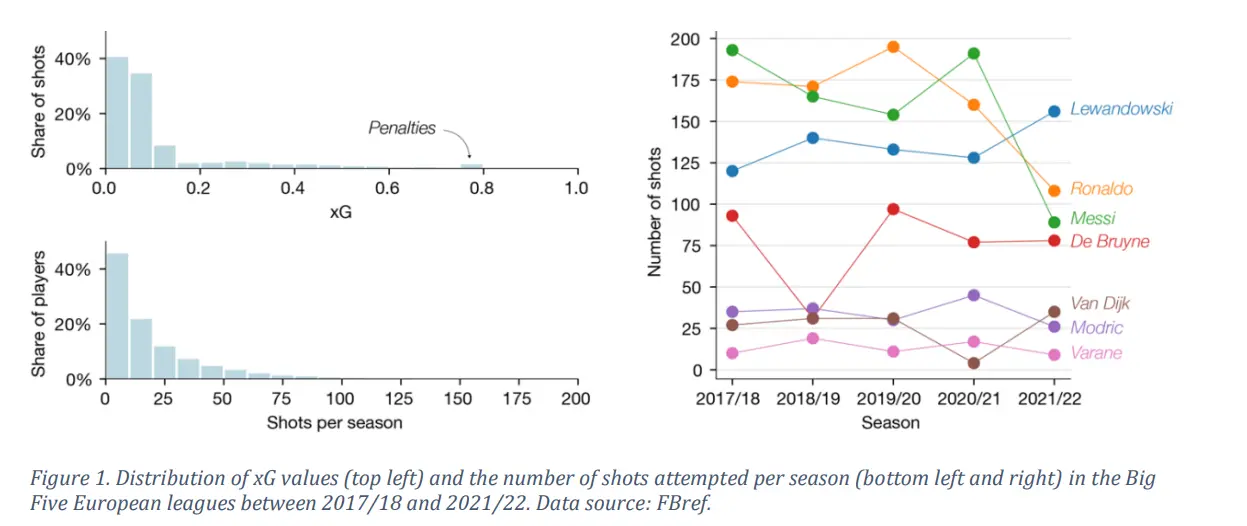

Durante décadas, el análisis del fútbol se basó en una pregunta simple: ¿cuántos goles marcó ese jugador? El problema es que esa cifra, por sí sola, dice muy poco. Un delantero puede marcar 15 goles habiendo tenido ocasiones clarísimas, o puede marcar 10 habiendo generado muy poco. El número final esconde demasiado. El xG (Expected Goals, o goles esperados) llegó para resolver precisamente eso. En lugar de contar goles, mide la calidad de cada disparo: ¿desde dónde se lanzó?, ¿con qué parte del cuerpo?, ¿a qué distancia estaba la portería?, ¿bajo qué presión defensiva? A cada disparo se le asigna un valor entre 0 y 1 que representa la probabilidad de que ese remate acabe en gol si lo ejecuta un jugador promedio. Un penalti tiene un xG de aproximadamente 0,76. Un disparo desde 35 metros y en ángulo cerrado puede rondar el 0,02. Con esta métrica nació también una forma de medir la habilidad rematadora: el GAX (Goals Above Expectation), que compara los goles reales de un jugador con su xG acumulado. Si un delantero supera consistentemente sus goles esperados, en teoría es un rematador excepcional.

Hasta aquí la lógica parece sólida. El problema es que, como demostraron los investigadores Jesse Davis y Pieter Robberechts de la Universidad KU Leuven en un estudio publicado en 2024, los modelos xG esconden tres sesgos importantes que distorsionan esa comparación. Primero: la muestra es demasiado pequeña. En las cinco grandes ligas europeas, solo el 9% de los jugadores llega a 50 disparos en una temporada. Con tan pocos datos, es casi imposible determinar si alguien supera su xG por habilidad real o simplemente por suerte. Las simulaciones del estudio muestran que incluso un rematador excepcional, con un 25% más de eficacia que la media, tiene tan solo un 70% de probabilidades de superar su xG en al menos cuatro de cinco temporadas consecutivas, y eso asumiendo que dispara más de 100 veces por temporada. Para la mayoría de los jugadores, la muestra no alcanza para sacar conclusiones fiables. Segundo: no todos los disparos son iguales a la hora de medir habilidad. Un remate desviado por un defensa no refleja la destreza del atacante. Un lanzamiento desesperado en el minuto 94 cuando se va perdiendo tampoco. Incluirlos en el cálculo contamina el resultado. El estudio analiza el caso de Paul Pogba para ilustrarlo: en cinco temporadas de Premier League, sus estadísticas globales lo situaban como rematador por debajo de la media, pero al filtrar solo sus disparos de larga distancia, donde realmente destaca, los números cambiaban por completo. El problema es que ese subconjunto de disparos es tan pequeño que las conclusiones estadísticas vuelven a ser endebles. Tercero, y el más interesante: el modelo está sesgado por los propios jugadores que lo entrenan. Este es el hallazgo más sofisticado del paper. Los modelos de xG se construyen a partir de millones de disparos históricos, pero esos disparos no provienen de jugadores "promedio": una parte significativa la generan los mejores rematadores del mundo, que disparan más y mejor. Eso hace que el modelo aprenda, sin saberlo, a asignar xG ligeramente más altos a los disparos desde posiciones donde suelen tirar los buenos finalizadores. El resultado: el modelo subestima sistemáticamente la habilidad de los grandes rematadores y sobreestima la de los mediocres. El caso de Messi lo ilustra con números: aplicando un modelo corregido mediante una técnica tomada de la literatura de equidad en inteligencia artificial (llamada multi-calibración), los investigadores calcularon que el xG estándar infravalora el GAX de Messi en torno a un 17%. Y comparado con otros atacantes de alto volumen de disparo de élite, Messi supera las expectativas en un 27% adicional, lo que sugiere que su habilidad como finalizador estaba siendo sistemáticamente subestimada por los propios modelos que supuestamente la medían.

¿Qué significa esto para el debate sobre la dependencia de los datos? Que una de las métricas más usadas en el fútbol moderno, aquella que aparece en retransmisiones televisivas, que guía fichajes y que los analistas manejan a diario, tiene limitaciones matemáticas profundas que no son evidentes a simple vista. Usarla bien requiere entender qué preguntas puede y no puede responder. Como concluyen Davis y Robberechts: el xG es una herramienta valiosa cuando se usa para entender desde qué zonas se generan buenas ocasiones o qué equipos dominan tácticamente. Pero cuando se emplea para juzgar la habilidad individual de un jugador, sin considerar el volumen de disparos, el tipo de remate ni los sesgos del modelo, puede llevar a conclusiones erróneas.

Este apartado resume los hallazgos principales del artículo académico "Biases in Expected Goals Models Confound Finishing Ability", de Jesse Davis y Pieter Robberechts (KU Leuven, Dept. of Computer Science; Leuven.AI), publicado en 2024. El texto original ha sido adaptado y simplificado con fines divulgativos. Puedes consultar el estudio completo en "Biases in Expected Goals Models Confound Finishing Ability"

Datos posicionales y seguimiento GPS en tiempo real

Una de las grandes revoluciones del análisis moderno es la capacidad de registrar la posición exacta de los jugadores en cada momento del partido. Gracias a sistemas de seguimiento óptico y dispositivos GPS, se pueden recopilar millones de datos sobre movimientos, velocidades, aceleraciones y distancias recorridas en tiempo real.

Este tipo de información permite analizar aspectos que antes eran prácticamente invisibles, como la ocupación de espacios, las basculaciones defensivas o la sincronización entre líneas. Por ejemplo, se puede medir la distancia entre defensas para evaluar la solidez de un bloque o detectar desajustes en la presión colectiva.

Además, el seguimiento en tiempo real facilita la toma de decisiones durante el propio partido. Los cuerpos técnicos pueden acceder a datos físicos y tácticos casi al instante, lo que ayuda a gestionar cargas de esfuerzo, detectar signos de fatiga o ajustar planteamientos según el comportamiento del equipo y del rival.

Este enfoque no solo aporta precisión, sino que también convierte el análisis en un proceso continuo, donde cada acción queda registrada y puede ser revisada posteriormente con un alto nivel de detalle.

Big Data y herramientas como StatsBomb, Wyscout u Opta

El crecimiento del volumen de datos ha dado lugar al uso del Big Data en el fútbol, donde grandes cantidades de información se procesan para encontrar patrones, tendencias y comportamientos relevantes. Este enfoque va más allá del análisis puntual de partidos, permitiendo estudiar ligas completas, comparar jugadores o anticipar rendimientos futuros.

En este contexto han surgido plataformas especializadas como StatsBomb, Wyscout y Opta, que recopilan y estructuran datos de miles de encuentros en todo el mundo. Estas herramientas ofrecen métricas avanzadas, visualizaciones interactivas y bases de datos históricas que facilitan el trabajo de analistas, entrenadores y ojeadores.

Por ejemplo, permiten comparar el rendimiento de jugadores en diferentes competiciones, analizar patrones de juego de un rival o identificar talentos emergentes a partir de indicadores objetivos. También integran vídeo y datos, lo que ayuda a contextualizar cada acción dentro del desarrollo real del partido.

El uso de estas plataformas ha contribuido a profesionalizar el análisis, haciendo que el acceso a la información sea más amplio y preciso. Al mismo tiempo, ha cambiado la forma en que se interpreta el fútbol, incorporando una dimensión más analítica sin dejar de lado la observación directa del juego.

Scouting inteligente: cómo los datos transforman los fichajes

El uso de datos ha cambiado la forma en que los clubes identifican y evalúan talento. El scouting tradicional, basado en la observación directa, se complementa ahora con bases de datos que permiten filtrar jugadores según métricas específicas como rendimiento ofensivo, impacto defensivo o regularidad.

Esto facilita detectar perfiles que encajan en un sistema de juego concreto, incluso en ligas menos mediáticas. Además, reduce el margen de error al aportar una visión más objetiva del rendimiento a lo largo del tiempo, no solo en momentos puntuales. Aun así, los datos no sustituyen la observación cualitativa, sino que actúan como una herramienta previa para acotar y optimizar la búsqueda de jugadores.

El debate sobre la intuición entrenador fútbol frente al uso de datos es cada vez más habitual. Sin embargo, plantearlo como una oposición puede ser simplista. La intuición del entrenador se basa en experiencia, conocimiento del vestuario y lectura del contexto, aspectos que los datos no siempre pueden capturar.

Por otro lado, el análisis cuantitativo aporta información objetiva que puede confirmar o cuestionar percepciones. En la práctica, ambos enfoques tienden a complementarse: los datos ayudan a reducir la incertidumbre, mientras que la intuición permite interpretar matices que no aparecen en los números. Más que elegir entre uno u otro, la tendencia actual apunta a integrar ambas perspectivas en la toma de decisiones.

La brecha tecnológica entre grandes clubes y equipos modestos

El acceso a tecnologías avanzadas y grandes volúmenes de datos no es igual para todos los clubes. Las entidades con más recursos cuentan con departamentos especializados, herramientas sofisticadas y capacidad para procesar información a gran escala.

En cambio, los equipos modestos suelen trabajar con recursos más limitados, lo que puede generar una desventaja en áreas como el análisis de rivales, la captación de talento o la optimización del rendimiento.

No obstante, la progresiva democratización de algunas plataformas y herramientas está reduciendo parcialmente esta brecha. Cada vez más clubes pueden acceder a datos básicos y soluciones accesibles, lo que contribuye a equilibrar, al menos en parte, el uso de la analítica en el fútbol.

El dato como herramienta, no como sustituto de la inteligencia táctica

El crecimiento del análisis de datos ha ampliado la forma de entender el fútbol, aportando nuevas perspectivas y herramientas para estudiar el juego. Sin embargo, su valor reside en cómo se utiliza.

Los datos permiten interpretar mejor lo que ocurre en el campo, pero no reemplazan la comprensión táctica, la experiencia ni la toma de decisiones en contextos complejos. En este sentido, el equilibrio entre análisis y conocimiento futbolístico sigue siendo clave para entender el deporte en toda su dimensión.